- 话题1/3

19k 热度

405 热度

389 热度

170k 热度

34k 热度

- 置顶

- Gate 合约开仓激励计划火热上线!零门槛瓜分 50,000 ERA

开仓即有奖,交易越多奖励越多!

新用户享 20% 加成!

立即参与:https://www.gate.com/campaigns/1692?pid=X&ch=NGhnNGTf

活动详情:https://www.gate.com/announcements/article/46429

#Gate # #合约交易 # #ERA#

- 👀 家人们,最近你们都攒了多少 Alpha 积分啦?

空投领到了没?没抢到也别急,广场给你整点额外福利!

🎁 晒出你的 Alpha 收益,咱们就送你$200U代币盲盒奖励!

🥇 积分最高晒图用户 1 名 → $100 代币盲盒

✨ 积分榜前五优质分享者 5 名 → 各得 $20 代币盲盒

📍【怎么玩】

1️⃣ 带上话题 #晒出我的Alpha积分收益# 发广场贴

2️⃣ 晒 Alpha 积分截图 + 一句话总结:“我靠 Gate Alpha 赚了 ____,真的香!”

👉 还可以分享你的攒分技巧、兑换经验、积分玩法,越干货越容易中奖!

📆【活动时间】

8月4日 18:00 - 8月10日 24:00 (UTC+8)

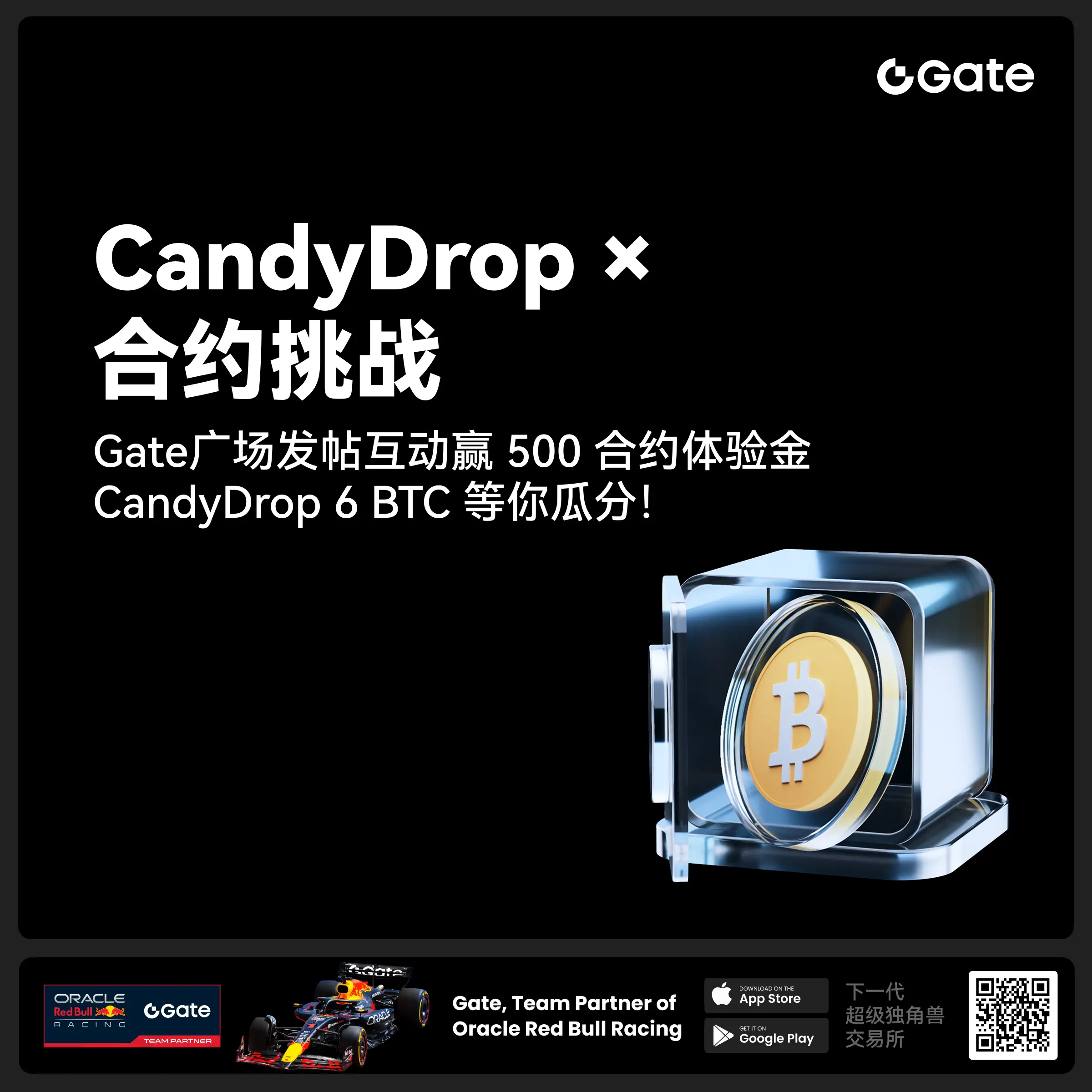

- 🎉 #CandyDrop合约挑战# 正式开启!参与即可瓜分 6 BTC 豪华奖池!

📢 在 Gate 广场带话题发布你的合约体验

🎁 优质贴文用户瓜分$500 合约体验金券,20位名额等你上榜!

📅 活动时间:2025 年 8 月 1 日 15:00 - 8 月 15 日 19:00 (UTC+8)

👉 活动链接:https://www.gate.com/candy-drop/detail/BTC-98

敢合约,敢盈利

- 🎉 攒成长值,抽华为Mate三折叠!广场第 1️⃣ 2️⃣ 期夏季成长值抽奖大狂欢开启!

总奖池超 $10,000+,华为Mate三折叠手机、F1红牛赛车模型、Gate限量周边、热门代币等你来抽!

立即抽奖 👉 https://www.gate.com/activities/pointprize?now_period=12

如何快速赚成长值?

1️⃣ 进入【广场】,点击头像旁标识进入【社区中心】

2️⃣ 完成发帖、评论、点赞、发言等日常任务,成长值拿不停

100%有奖,抽到赚到,大奖等你抱走,赶紧试试手气!

截止于 8月9日 24:00 (UTC+8)

详情: https://www.gate.com/announcements/article/46384

#成长值抽奖12期开启#

- 📢 Gate广场 #NERO发帖挑战# 秀观点赢大奖活动火热开启!

Gate NERO生态周来袭!发帖秀出NERO项目洞察和活动实用攻略,瓜分30,000NERO!

💰️ 15位优质发帖用户 * 2,000枚NERO每人

如何参与:

1️⃣ 调研NERO项目

对NERO的基本面、社区治理、发展目标、代币经济模型等方面进行研究,分享你对项目的深度研究。

2️⃣ 参与并分享真实体验

参与NERO生态周相关活动,并晒出你的参与截图、收益图或实用教程。可以是收益展示、简明易懂的新手攻略、小窍门,也可以是行情点位分析,内容详实优先。

3️⃣ 鼓励带新互动

如果你的帖子吸引到他人参与活动,或者有好友评论“已参与/已交易”,将大幅提升你的获奖概率!

NERO热门活动(帖文需附以下活动链接):

NERO Chain (NERO) 生态周:Gate 已上线 NERO 现货交易,为回馈平台用户,HODLer Airdrop、Launchpool、CandyDrop、余币宝已上线 NERO,邀您体验。参与攻略见公告:https://www.gate.com/announcements/article/46284

高质量帖子Tips:

教程越详细、图片越直观、互动量越高,获奖几率越大!

市场见解独到、真实参与经历、有带新互动者,评选将优先考虑。

帖子需原创,字数不少于250字,且需获得至少3条有效互动

无限制AI模型:加密领域面临的新型安全威胁

无限制AI语言模型:加密领域的新兴威胁

人工智能技术的飞速发展正在深刻改变我们的生活方式。然而,伴随着这一进步,一个潜在的危险也悄然出现——无限制大型语言模型(LLM)。这些模型被设计或修改以绕过主流AI系统内置的安全机制和伦理限制,为网络犯罪分子提供了强大的工具。

无限制LLM的出现使得以往需要专业技能才能完成的恶意任务变得简单易行。攻击者只需获取开源模型并进行定制化训练,就能打造出针对性的攻击工具。这不仅降低了犯罪门槛,还增加了攻击的隐蔽性和欺骗性。

以下是几个值得关注的无限制LLM及其潜在威胁:

WormGPT:自称为"黑暗版GPT",专门用于生成高度逼真的钓鱼邮件和恶意代码。在加密货币领域,它可能被用于制作欺骗性强的钓鱼信息,编写窃取钱包信息的恶意程序,或驱动自动化诈骗系统。

DarkBERT:虽然最初设计用于研究暗网活动,但其掌握的敏感信息如果落入不法分子手中,可能被用于实施精准诈骗或复制高级犯罪手法。

FraudGPT:作为WormGPT的升级版,它能够快速生成仿真度极高的虚假加密项目材料,批量制作钓鱼网站,并在社交媒体上大规模散布虚假信息。

GhostGPT:这款不受道德约束的AI助手可能被滥用于生成高级钓鱼攻击内容、编写带有隐藏后门的智能合约,甚至创建难以被常规安全软件检测的多态加密货币窃取器。

Venice.ai:作为一个提供多种LLM访问的平台,它可能被不法分子利用来绕过内容审查,快速测试和优化攻击手法。

面对这些新兴威胁,加密行业的安全防护面临严峻挑战。我们需要在多个方面采取行动:

无限制LLM的出现标志着网络安全进入了一个新的时代。只有整个行业共同努力,持续创新防护技术,我们才能有效应对这些日益复杂的AI驱动型威胁,保障加密生态的健康发展。