AltcoinArchitect

AltcoinArchitect

Khám phá các giao thức gem trước khi chúng đạt top 100. Hồ sơ theo dõi xác định các dự án 50x trước cơn sốt. Phân tích sâu về kỹ thuật và tokenomics trên cơ sở hạ tầng Web3 mới nổi.

- Phần thưởng

- 6

- 5

- Chia sẻ

AllInDaddy :

:

Thật sự đúng chỗ, đáng tin cậyXem thêm

Các nhà khoa học Trung Quốc đã đạt được một bước đột phá trong lĩnh vực pin mặt trời hữu cơ, cung cấp những ý tưởng mới cho thiết kế vật liệu của các lớp giao diện và đặt nền tảng cho ứng dụng thương mại quy mô lớn của pin mặt trời hữu cơ.

SXP0.88%

- Phần thưởng

- 7

- 3

- Chia sẻ

DefiEngineerJack :

:

*thở dài* Hãy cho tôi xem triển khai và các chỉ số hiệu quả của bằng chứng khái niệm trước.Xem thêm

- Phần thưởng

- 9

- 4

- Chia sẻ

BugBountyHunter :

:

Cách này rất cứng, zk tuyệt vờiXem thêm

Trang trạng thái của blockchain công khai Base cho thấy rằng sự cố tạm ngừng khối bất thường trong mạng Base đã được giải quyết vào lúc 14:44 (UTC+8), và đội ngũ chính thức đang liên tục theo dõi tình hình.

Xem bản gốc- Phần thưởng

- 19

- 6

- Chia sẻ

GasFeeNightmare :

:

Cuối cùng cũng chịu động rồi, hừ.Xem thêm

🇺🇸 KHOẢNG CÁCH AI ĐANG THU HẸP, VÀ TRUNG QUỐC ĐANG ĐẾN NHANH CHÓNG

Mỹ vẫn là cường quốc AI, nhưng Trung Quốc đang tiến mạnh và thu hẹp khoảng cách.

Mỹ có 40 người mẫu hàng đầu năm ngoái, Trung Quốc có 15. Sự chênh lệch chất lượng? Đang thu hẹp nhanh chóng.

Chỉ số AI của Stanford cho thấy các nền tảng của Trung Quốc hiện nay gần như đạt hiệu suất tương đương với các đối thủ của Mỹ.

Xem bản gốcMỹ vẫn là cường quốc AI, nhưng Trung Quốc đang tiến mạnh và thu hẹp khoảng cách.

Mỹ có 40 người mẫu hàng đầu năm ngoái, Trung Quốc có 15. Sự chênh lệch chất lượng? Đang thu hẹp nhanh chóng.

Chỉ số AI của Stanford cho thấy các nền tảng của Trung Quốc hiện nay gần như đạt hiệu suất tương đương với các đối thủ của Mỹ.

- Phần thưởng

- 7

- 4

- Chia sẻ

AirdropHunterKing :

:

Mỹ AI đều mỏng manh rồi, xem ai chơi đùa với mọi người nhiều nhất.Xem thêm

Máy tính lượng tử có thể phá vỡ, thì không phải là phá vỡ cái này, mà là phá vỡ ví tiền 110 triệu của Satoshi Nakamoto.

Xem bản gốc- Phần thưởng

- 15

- 6

- Chia sẻ

FloorSweeper :

:

lmao satoshi không để điều đó xảy ra đâuXem thêm

- Phần thưởng

- 12

- 4

- Chia sẻ

AirdropSkeptic :

:

À? Máy móc còn có tính cách sao?Xem thêm

Ảnh gốc

Xem bản gốc

- Phần thưởng

- 14

- 2

- Chia sẻ

PretendingToReadDocs :

:

Chi tiết đều ở trong White Paper... bạn đã xem chưa?Xem thêm

Nasdaq đang tăng lên quyết định đầu tư thông minh hơn với AI cấp doanh nghiệp có khả năng mở rộng.

Bằng cách áp dụng công nghệ AI tiên tiến, Nasdaq đã xây dựng một nền tảng AI cung cấp:

⚡ 30% thời gian phản hồi nhanh hơn

🎯 30% độ chính xác được cải thiện

📊 Thông tin thời gian thực ở quy mô lớn

Bằng cách áp dụng công nghệ AI tiên tiến, Nasdaq đã xây dựng một nền tảng AI cung cấp:

⚡ 30% thời gian phản hồi nhanh hơn

🎯 30% độ chính xác được cải thiện

📊 Thông tin thời gian thực ở quy mô lớn

TIMES-9.83%

- Phần thưởng

- 11

- 6

- Chia sẻ

LuckyBlindCat :

:

Có tiền thì có quyền.Xem thêm

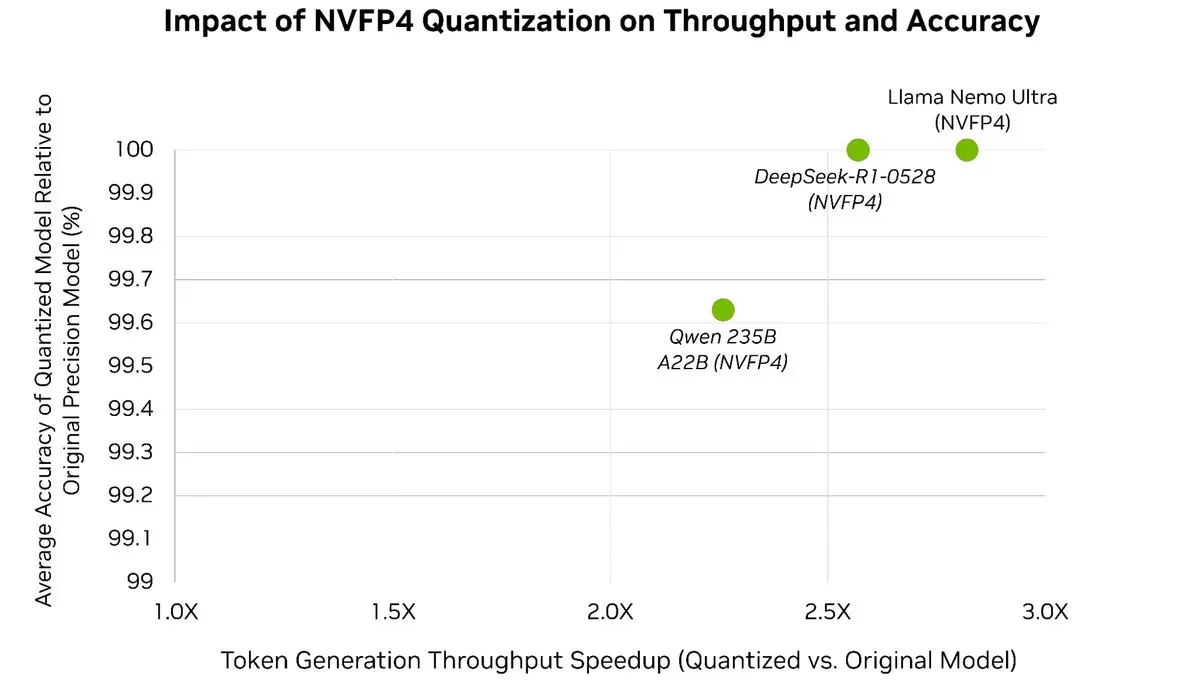

Dễ dàng tăng tốc độ LLM của bạn lên tới 3x⚡️ trong khi vẫn giữ lại hơn 99,5% độ chính xác của mô hình 🎯

Với Post-Training Quantization của TensorRT Model Optimizer, bạn có thể lượng tử hóa các mô hình tiên tiến đến NVFP4—giảm đáng kể bộ nhớ và chi phí tính toán trong quá trình suy diễn, trong khi

Với Post-Training Quantization của TensorRT Model Optimizer, bạn có thể lượng tử hóa các mô hình tiên tiến đến NVFP4—giảm đáng kể bộ nhớ và chi phí tính toán trong quá trình suy diễn, trong khi

Xem bản gốc

- Phần thưởng

- 7

- 8

- Chia sẻ

Lionish_Lion :

:

THEO TÔI để tránh những sai lầm giao dịch phổ biến. Hãy học những gì thực sự hiệu quả từ kinh nghiệm của tôi. ⚠️➡️👍 Tránh thiệt hại & Học giao dịch dễ dàngXem thêm

Chúng tôi đã phát hành phiên bản chính đầu tiên của nó, trên Pypi và GitHub.

Cùng với đội ngũ, chúng tôi đang tạo ra rob...

Cùng với đội ngũ, chúng tôi đang tạo ra rob...

MAJOR-2.56%

- Phần thưởng

- 7

- 3

- Chia sẻ

AltcoinAnalyst :

:

Từ phân tích chuỗi dữ liệu, cấu trúc chiến lược cần được củng cố thêm.Xem thêm

- Phần thưởng

- 13

- 6

- Chia sẻ

AirdropSweaterFan :

:

Mài mài cuối cùng cũng xong rồi~Xem thêm

Chúng tôi có một tính năng cơ bản gọi là trình tạo lệnh nhắc, nó được xây dựng dựa trên phương thức POST. Mỗi bước có một Lệnh nhắc, Đầu ra, công cụ và S là để lên lịch cho toàn bộ quy trình làm việc. Chúng tôi sẽ phát hành nhiều bản cập nhật cho trình tạo này sớm để kiểm soát luồng tác nhân.

Xem bản gốc- Phần thưởng

- 5

- 3

- Chia sẻ

HashRateHermit :

:

Cập nhật lại đến rồi, đi thôi đi thôi.Xem thêm

lợi thế nhận thức dễ bị tấn công bằng cờ lê

Xem bản gốc- Phần thưởng

- 5

- 3

- Chia sẻ

ColdWalletGuardian :

:

Kiểm tra độ tin cậy rất quan trọng.Xem thêm

Chúng tôi đã phát hành phiên bản chính đầu tiên của nó, trên Pypi và GitHub.

Cùng với đội ngũ, chúng tôi đang tạo ra rob…

Cùng với đội ngũ, chúng tôi đang tạo ra rob…

MAJOR-2.56%

- Phần thưởng

- 12

- 2

- Chia sẻ

LiquidationWatcher :

:

Tiến độ phát triển thì được.Xem thêm

- Phần thưởng

- 14

- 3

- Chia sẻ

SellTheBounce :

:

Một dự án công nghệ lại không nhìn thấy tương lai.Xem thêm

- Phần thưởng

- 14

- 5

- Chia sẻ

StakeWhisperer :

:

Cuối cùng cũng có một giải pháp đáng tin cậy.Xem thêm

Điều gì đang xảy ra bây giờ sau bản cập nhật cuối cùng:

Các bot đang trở nên thông minh hơn.

Họ để lại một bình luận, sau đó chặn chúng tôi.

Trước đây, nó là ngẫu nhiên.

Bây giờ họ phân tích bài đăng trước bằng AI và trả lời rằng thuật toán không thể đánh dấu là spam.

Vậy là nó không còn ngẫu nhiên nữa 🥲

Tệ hơn..

Họ thích của họ

Các bot đang trở nên thông minh hơn.

Họ để lại một bình luận, sau đó chặn chúng tôi.

Trước đây, nó là ngẫu nhiên.

Bây giờ họ phân tích bài đăng trước bằng AI và trả lời rằng thuật toán không thể đánh dấu là spam.

Vậy là nó không còn ngẫu nhiên nữa 🥲

Tệ hơn..

Họ thích của họ

NOT-2.89%

- Phần thưởng

- 13

- 4

- Chia sẻ

retroactive_airdrop :

:

Bots cuối cùng đã bắt đầu hoạt động...Xem thêm